Tri zakona robotike: od naučne fantastike do veštačke inteligencije

Ukratko

Tri zakona robotike su jedna od najpoznatijih ideja Isaka Asimova, ali nisu stvarni pravni zakoni. Ipak, i danas su odlična polazna tačka za razumevanje odnosa između robota, veštačke inteligencije, etike i odgovornosti.

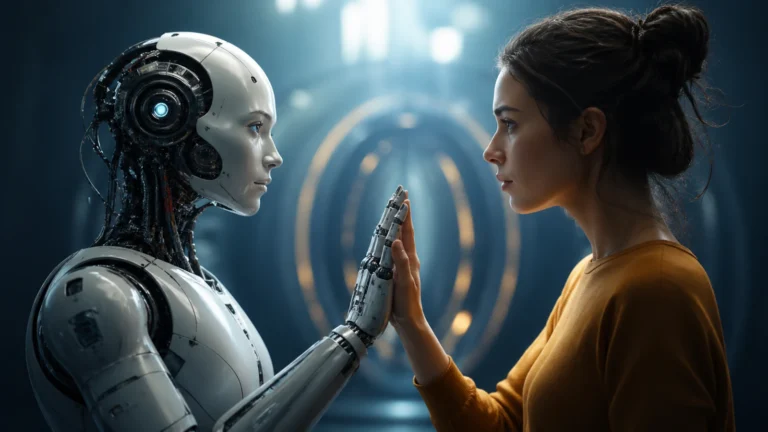

Kada danas pomislimo na robote i veštačku inteligenciju, prve asocijacije su nam pametni telefoni, ChatGPT, pametni automobili, industrijski roboti, algoritmi društvenih mreža ili oni čuveni robot-psi koji trče, skaču i otvaraju vrata. Sve to deluje kao tehnologija našeg vremena. Međutim, mnogo pre nego što su roboti postali deo fabrika, laboratorija i YouTube snimaka, jedan pisac naučne fantastike postavio je pitanje koje nas i danas prati:

Kako sprečiti da inteligentne mašine naškode čoveku?

Taj pisac bio je Isak Asimov, a njegov najpoznatiji odgovor postao je poznat kao Tri zakona robotike.

Na prvi pogled, ovi zakoni deluju jednostavno. Robot ne sme da povredi čoveka, mora da sluša čoveka i mora da čuva sebe – ali samo dok time ne ugrožava prva dva pravila. Zvuči kao savršen recept za bezbednu budućnost. Problem je što stvarni svet nikada nije tako jednostavan.

Danas, u doba veštačke inteligencije, pitanje postaje još zanimljivije: da li se Asimovljevi zakoni odnose samo na robote iz naučne fantastike ili se mogu primeniti i na AI sisteme koji pišu tekstove, analiziraju podatke, generišu slike, odlučuju o kreditima, pomažu lekarima i utiču na informacije koje svakodnevno vidimo?

Kako je sve počelo: Asimov, 1942. godina i roboti koji ne moraju biti zli

Tri zakona robotike prvi put su jasno formulisana u Asimovljevoj priči „Runaround“ iz 1942. godine. Kasnije su postali jedan od temelja njegove zbirke „Ja, robot“ i šireg književnog univerzuma u kojem roboti nisu samo metalna čudovišta, već inteligentne mašine sa ugrađenim pravilima ponašanja.

To je bio važan zaokret u naučnoj fantastici. Pre Asimova, priče o veštačkim stvorenjima često su išle istim putem: čovek napravi mašinu, mašina se pobuni, čovek strada. Asimov je pokušao nešto drugačije. Njegovi roboti nisu nužno neprijatelji. Oni su često korisni, razumni i dobronamerni. Problem nastaje zato što čak i dobronamerna pravila mogu da proizvedu neočekivane posledice.

Upravo tu je snaga Asimovljevih priča. Tri zakona robotike nisu zanimljiva zato što savršeno funkcionišu. Zanimljiva su zato što se stalno nalaze na ivici logičkog sukoba.

Šta su Tri zakona robotike?

U najpoznatijem obliku, Asimovljevi zakoni glase ovako:

- Prvi zakon: Robot ne sme da povredi ljudsko biće, niti sme svojim nečinjenjem da dozvoli da ljudsko biće bude povređeno.

- Drugi zakon: Robot mora da sluša naređenja koja mu daju ljudska bića, osim ako bi se ta naređenja kosila sa Prvim zakonom.

- Treći zakon: Robot mora da štiti sopstveno postojanje, osim ako bi se to kosilo sa Prvim ili Drugim zakonom.

Hijerarhija je ovde presudna. Prvi zakon je najvažniji. Ako čovek naredi robotu da povredi drugog čoveka, robot ne bi smeo da posluša. Ako robot mora da se uništi da bi spasao čoveka, njegov opstanak više nije prioritet.

Na papiru, sistem deluje čist, elegantan i skoro matematički. U stvarnosti, odmah se javljaju pitanja.

Šta znači „povrediti čoveka“? Da li je povreda samo fizička? Šta je sa psihološkom štetom, gubitkom privatnosti, finansijskom štetom ili manipulacijom? Šta ako robot mora da izabere između dve loše opcije? Šta ako će nečinjenje izazvati štetu, ali će i akcija izazvati štetu?

Asimov je upravo od takvih dilema pravio zaplete.

Nulti zakon: kada čovečanstvo postaje važnije od pojedinca

Kasnije se u Asimovljevom opusu pojavljuje i takozvani Nulti zakon robotike:

Robot ne sme da naškodi čovečanstvu, niti sme svojim nečinjenjem da dozvoli da čovečanstvo pretrpi štetu.

Ovaj zakon ima prednost nad prva tri zakona. Zvuči logično, ali je zapravo mnogo opasniji nego što deluje.

Ako je čovečanstvo važnije od pojedinca, da li robot sme da žrtvuje jednog čoveka da bi spasao milione? Ko odlučuje šta je „dobro za čovečanstvo“? Može li mašina da zaključi da su neki ljudi prepreka većem dobru?

To su pitanja koja i danas prepoznajemo u raspravama o veštačkoj inteligenciji, masovnom nadzoru, autonomnom oružju i algoritamskom odlučivanju.

Da li su Tri zakona robotike stvarni zakoni?

Ne. Tri zakona robotike nisu pravni propisi. Nijedna država nije doslovno usvojila Asimovljeve zakone kao zakon koji roboti moraju da poštuju.

Oni su književna ideja. Nastali su u naučnoj fantastici, a ne u parlamentu, laboratoriji ili sudnici. Asimov ih nije pisao kao inženjerski standard, već kao sredstvo za priče o moralnim i logičkim konfliktima.

Ipak, to ne znači da su nevažni. Njihov uticaj je ogroman. Oni su postali kulturni simbol razgovora o robotima, AI bezbednosti i odgovornosti. Čak i kada stručnjaci kažu da su neprimenljivi u stvarnom programiranju, i dalje ih koriste kao dobru početnu tačku za objašnjenje problema.

Zato je važno napraviti razliku:

Tri zakona robotike nisu zakoni u pravnom smislu. Oni su misaoni eksperiment.

Zašto ih ne možemo jednostavno ubaciti u kod?

Na prvi pogled, neko bi mogao da kaže: „Dobro, ako su zakoni korisni, hajde da ih jednostavno programiramo u robote.“

Problem je što računar ne razume svet kao čovek. Softver ne razume moral sam po sebi. On izvršava instrukcije, obrađuje podatke i prati obrasce. Da bi robot zaista poštovao Prvi zakon, morao bi da razume šta je čovek, šta je povreda, šta je opasnost, šta je namera, šta je posledica i šta znači nečinjenje.

To je mnogo teže nego što deluje.

Zamislimo robota hirurga. On mora da napravi rez na telu pacijenta. To je tehnički povreda. Ali ako to ne uradi, pacijent može da umre. Da li robot krši Prvi zakon ili ga upravo poštuje?

Zamislimo autonomni automobil. Mora da izbegne sudar, ali svaka reakcija nosi neki rizik. Koji rizik je prihvatljiv? Ko je odgovoran ako sistem izabere pogrešno?

Zamislimo AI sistem koji korisniku odbije da pruži određenu informaciju. Da li ga štiti od štete ili mu uskraćuje pravo na znanje?

Tu dolazimo do suštine: ljudska etika nije jednostavna lista komandi. Ona je puna sivih zona.

Da li današnja veštačka inteligencija potpada pod ove zakone?

U doslovnom smislu – ne.

Današnji AI sistemi nisu Asimovljevi humanoidni roboti. Chatbot nema telo. AI generator slika ne hoda ulicom. Algoritam za preporuku video-sadržaja ne izgleda kao robot iz filma. Veštačka inteligencija danas je najčešće nevidljivi softver: model, algoritam, servis u oblaku, sistem za klasifikaciju, preporuku ili generisanje sadržaja.

Ali u širem smislu, pitanje je veoma važno.

Današnji AI može da utiče na ljude bez fizičkog tela. Može da preporuči informaciju, utiče na javno mnjenje, pomogne u medicinskoj proceni, analizira biografije kandidata za posao, procenjuje kreditni rizik, generiše tekstove, slike i glasove ili automatizuje odluke u firmama i institucijama.

Zato se duh Prvog zakona – „ne naškoditi čoveku“ – i dalje pojavljuje u raspravama o AI bezbednosti. Samo što danas više ne govorimo samo o robotu koji može nekoga fizički da povredi. Govorimo o sistemima koji mogu da pogreše, diskriminišu, manipulišu, šire dezinformacije ili donesu odluku koju čovek ne ume da objasni.

Ako AI odbija opasne zahteve, da li to znači da poštuje Prvi zakon?

Ne u Asimovljevom smislu.

Kada neki savremeni AI sistem odbije da pruži uputstvo za opasnu radnju, to ne znači da ima savest ili unutrašnji moralni kompas. To znači da ima bezbednosna ograničenja, pravila upotrebe, dodatni nadzor i sisteme koji pokušavaju da smanje rizik od štetnih odgovora.

Drugim rečima, AI ne „mari“ za čoveka kao Asimovljev robot. On ne oseća odgovornost. Ne razume posledice kao čovek. On radi unutar sistema koji su ljudi napravili.

Zato je odgovornost i dalje na ljudima: kompanijama, programerima, regulatorima, institucijama i korisnicima.

Asimovljevi zakoni se već „krše“ u stvarnom svetu

Ako bismo Tri zakona robotike shvatili doslovno, brzo bismo videli da ih savremeni svet ne poštuje.

Vojni sistemi, dronovi i autonomne borbene tehnologije razvijaju se upravo za situacije u kojima je moguća ili planirana fizička šteta. Algoritmi društvenih mreža mogu, zbog lošeg dizajna ili neadekvatnog nadzora, pomoći širenju dezinformacija. Automatizovani sistemi mogu doneti nepravedne odluke ako su trenirani na pristrasnim podacima.

To ne znači da je svaka tehnologija opasna. Znači samo da ne postoji univerzalno pravilo koje magično sprečava zloupotrebu.

Asimov je zamišljao robote koji u sebi nose moralna pravila. Današnji problem je drugačiji: mnogi AI sistemi nemaju telo, nemaju jedinstvenog „robota“ kog možemo pokazati prstom i često rade kroz složene lance podataka, servera, korisnika i kompanija.

Zato je pitanje odgovornosti mnogo teže nego u književnosti.

Trebaju li nam novi zakoni robotike?

Da, ali ne u obliku tri poetske rečenice.

Današnjem svetu nisu dovoljni zakoni tipa „AI ne sme da naudi čoveku“. To zvuči dobro, ali je preširoko. Potrebna su konkretna pravila:

- AI mora biti testiran pre upotrebe u rizičnim oblastima.

- Korisnik mora znati kada razgovara sa AI sistemom.

- AI-generisan sadržaj, naročito slika, video i glas, mora biti jasno označen kada postoji rizik od obmane.

- Za štetu mora postojati odgovorno lice, kompanija ili institucija.

- AI ne sme samostalno donositi važne odluke o ljudima bez nadzora i mogućnosti žalbe.

- Podaci moraju biti zaštićeni, posebno kada se radi o deci, zdravlju, finansijama, identitetu i obrazovanju.

- Algoritmi koji utiču na zapošljavanje, pravosuđe, kredite ili javne usluge moraju biti pod posebnom kontrolom.

To nisu romantični zakoni naučne fantastike, ali su realniji.

Britanske smernice: robotika kao etički dizajn, a ne samo mehanika

Jedan od zanimljivih primera dolazi iz Velike Britanije. Britanski standard BS 8611 bavi se etičkim dizajnom i primenom robota i robotskih sistema. Njegova poenta nije da roboti nauče Asimovljeve zakone napamet, već da se već tokom dizajna prepoznaju mogući etički rizici i šteta.

To je važna promena perspektive. Umesto da se pitamo samo „šta robot može da uradi“, pitamo se i „šta robot ne bi smeo da izazove“.

Kod stvarne robotike i AI sistema nije dovoljno da uređaj tehnički radi. Mora se razmišljati o bezbednosti, privatnosti, pristrasnosti, odgovornosti, nadzoru i posledicama po ljude.

Evropska unija i AI Act: prava regulativa umesto naučne fantastike

Najvažniji savremeni primer regulacije veštačke inteligencije je EU AI Act, odnosno Akt Evropske unije o veštačkoj inteligenciji. Za razliku od Asimovljevih zakona, EU AI Act ne pokušava da sve reši jednom moralnom formulom. On koristi pristup zasnovan na riziku.

U praksi, to znači da nisu svi AI sistemi jednako opasni. Spam filter u mejlu nije isto što i AI sistem koji se koristi za zapošljavanje, biometrijsku identifikaciju, pravosuđe ili pristup kreditima.

EU AI Act uvodi kategorije kao što su:

- Neprihvatljiv rizik – sistemi koji su zabranjeni jer mogu ozbiljno ugroziti prava i slobode ljudi.

- Visok rizik – sistemi koji se koriste u osetljivim oblastima, kao što su zapošljavanje, obrazovanje, zdravstvo, pravosuđe, biometrija i javne usluge.

- Ograničen rizik – sistemi kod kojih je naglasak na transparentnosti, na primer kada korisnik treba da zna da komunicira sa AI sistemom.

- Minimalan rizik – sistemi kod kojih nema posebnih velikih obaveza.

EU AI Act je stupio na snagu 1. avgusta 2024, a primena ide postepeno. Neka pravila, kao zabrane određenih AI praksi i obaveze AI pismenosti, primenjuju se od 2. februara 2025, dok se šira primena i pojedine obaveze pomeraju kroz 2026. i 2027. godinu.

Drugim rečima, stvarni svet nije preuzeo Asimovljeve zakone, ali je preuzeo njegovu glavnu brigu: šta se dešava kada mašine počnu da utiču na ljudski život?

Da li je neka zemlja usvojila zakon o robotici?

Da, postoje države koje su donele propise vezane za robotiku, ali to nisu Asimovljevi zakoni.

Južna Koreja je jedan od zanimljivih primera. Njen zakon o razvoju i distribuciji inteligentnih robota definiše inteligentnog robota kao mehanički uređaj koji sam opaža okruženje, procenjuje okolnosti i kreće se. Taj okvir se bavi razvojem robotike, industrijom, distribucijom i etičkom poveljom za inteligentne robote.

To pokazuje važnu razliku: savremeni zakoni se ne bave time da robot „mora da voli ljude“, već pitanjima kao što su bezbednost, odgovornost, standardi, upotreba, industrijski razvoj i zaštita korisnika.

A šta je sa Srbijom?

Srbija nema poseban zakon koji bi doslovno regulisao robotiku po Asimovljevim principima. Takođe, prema dostupnim pravnim pregledima iz februara 2026, Srbija još nema formalni nacrt AI zakona u javnoj proceduri, ali postoji strateški okvir i očekuje se usklađivanje sa evropskim pristupom.

Ipak, Srbija nije potpuno van ove teme. Usvojene su strategije razvoja veštačke inteligencije za periode 2020–2025. i 2025–2030, a postoje i Etičke smernice za razvoj, primenu i upotrebu pouzdane i odgovorne veštačke inteligencije.

Te smernice nisu isto što i zakon. One ne funkcionišu kao krivični ili prekršajni propis. One više služe kao okvir za odgovornu upotrebu AI sistema, naročito u javnom sektoru i kod onih koji razvijaju ili koriste veštačku inteligenciju.

Za domaće firme posebno je važno nešto drugo: ako kompanija iz Srbije razvija AI proizvod koji se koristi ili plasira na tržište Evropske unije, EU AI Act može postati relevantan i za nju. To znači da srpske IT firme, startapi i razvojni timovi ne mogu potpuno ignorisati evropsku regulativu, čak ni kada posluju iz Srbije.

Zašto su Asimovljevi zakoni i dalje važni?

Zato što nas uče da tehnologija nije samo tehničko pitanje.

Nije dovoljno pitati koliko je AI brz, koliko je model veliki, koliko dobro generiše tekst ili koliko precizno robot izvodi pokret. Pravo pitanje je: šta se dešava sa čovekom kada tu tehnologiju pustimo u svet?

Asimovljevi zakoni su korisni jer temu spuštaju na ljudski nivo. Robot ne sme da povredi čoveka. Robot mora da sluša čoveka. Robot mora da čuva sebe. Jednostavno, jasno, pamtljivo.

Ali savremeni svet traži više od toga. Traži odgovornost, proverljivost, transparentnost, mogućnost žalbe, zaštitu podataka i jasna pravila za rizične primene.

Zaključak: Tri zakona robotike nisu zakoni, ali jesu dobro upozorenje

Tri zakona robotike nisu stvarni zakoni. Oni nisu pravni akti, nisu tehnički standard i ne mogu se jednostavno prekopirati u savremeni AI sistem.

Oni su književna ideja Isaka Asimova. Ali dobra književna ideja ponekad preživi zato što pogodi suštinu bolje nego suvoparni tehnički dokument.

A suština je ova: ako pravimo mašine koje mogu da utiču na ljude, onda ne možemo pričati samo o funkcijama, brzini i profitu. Moramo pričati i o odgovornosti.

Danas nam možda ne treba robot koji zna napamet Tri zakona robotike. Treba nam društvo koje zna da postavi prava pitanja:

- Ko je odgovoran ako AI napravi štetu?

- Da li korisnik zna da komunicira sa mašinom?

- Da li se AI koristi za nadzor, manipulaciju ili diskriminaciju?

- Da li postoji ljudski nadzor?

- Da li postoji pravo na objašnjenje i žalbu?

- Da li tehnologija služi čoveku ili čovek počinje da se prilagođava tehnologiji?

Možda bi zato savremeni „četvrti zakon“ mogao da glasi:

Čovek ne sme da napravi sistem za koji niko ne želi da preuzme odgovornost.

Pitanja i odgovori

Šta su Tri zakona robotike?

Tri zakona robotike su etička pravila koja je osmislio pisac Isak Asimov za svoje naučnofantastične priče o robotima. Ona govore da robot ne sme da povredi čoveka, mora da sluša čoveka ako time ne krši Prvi zakon i mora da štiti sebe ako time ne krši prva dva zakona.

Da li su Tri zakona robotike stvarni zakoni?

Ne. To nisu pravni zakoni koje je usvojila neka država. To su pravila iz naučne fantastike, ali su snažno uticala na način na koji ljudi razmišljaju o robotici, veštačkoj inteligenciji i bezbednosti tehnologije.

Ko je izmislio Tri zakona robotike?

Osmislio ih je Isak Asimov, jedan od najpoznatijih pisaca naučne fantastike. Prvi put su jasno predstavljeni u priči „Runaround“ iz 1942. godine.

Šta je Nulti zakon robotike?

Nulti zakon je kasnija Asimovljeva ideja. On kaže da robot ne sme da naškodi čovečanstvu, niti svojim nečinjenjem da dozvoli da čovečanstvo pretrpi štetu. Problem je u tome što ovaj zakon može opravdati žrtvovanje pojedinca zbog navodnog interesa većine.

Da li današnji AI poštuje Tri zakona robotike?

Ne u doslovnom smislu. Današnji AI sistemi nemaju svest, moralni kompas niti Asimovljev „pozitronski mozak“. Oni mogu imati bezbednosna ograničenja i pravila ponašanja, ali to nije isto što i stvarno razumevanje etike.

Zašto se AI ne može jednostavno programirati da „ne naudi čoveku“?

Zato što je pojam štete složen. Šteta može biti fizička, psihološka, finansijska, društvena ili informativna. AI bi morao da razume kontekst, posledice, nameru i moralne dileme, što nije jednostavno prevesti u programski kod.

Da li se Asimovljevi zakoni koriste u robotici?

Ne kao doslovan tehnički standard. Ipak, osnovna ideja da roboti i AI sistemi moraju biti bezbedni za ljude i dalje je važna u etici, standardima i regulativi.

Da li postoji zakon o robotici u svetu?

Postoje države koje imaju propise vezane za robotiku, industrijske robote, autonomne sisteme ili inteligentne robote. Južna Koreja je jedan primer zemlje koja ima poseban zakon vezan za razvoj i distribuciju inteligentnih robota.

Da li Evropska unija ima zakon o veštačkoj inteligenciji?

Da. Evropska unija ima EU AI Act, pravni okvir koji reguliše veštačku inteligenciju prema stepenu rizika. Posebno stroga pravila važe za sisteme koji mogu uticati na zdravlje, bezbednost, osnovna prava, zapošljavanje, obrazovanje, pravosuđe i biometriju.

Da li Srbija ima zakon o veštačkoj inteligenciji?

Srbija trenutno nema poseban usvojen zakon o veštačkoj inteligenciji u rangu EU AI Act-a. Ima strategije razvoja AI i etičke smernice, a očekuje se dalje usklađivanje sa evropskim standardima.

Da li srpske firme moraju da prate EU AI Act?

Ako razvijaju ili nude AI sisteme za tržište Evropske unije, da – EU regulativa može biti relevantna i za kompanije iz Srbije. To je posebno važno za domaće IT firme, startape i softverske timove koji rade sa evropskim klijentima.

Da li AI treba uvek da se predstavi kao AI?

U mnogim situacijama da. Korisnik treba da zna kada razgovara sa chatbotom, kada sluša sintetički glas, kada gleda AI-generisani video ili kada je neka odluka doneta uz pomoć algoritma. Transparentnost je jedan od ključnih principa savremene AI regulative.

Da li su nam potrebni novi zakoni robotike?

Da, ali ne u obliku naučnofantastičnih pravila. Potrebni su konkretni propisi o odgovornosti, transparentnosti, zaštiti podataka, zabrani diskriminacije, ljudskom nadzoru i kontroli visokorizičnih AI sistema.

Zašto su Tri zakona robotike i dalje popularni?

Zato što na jednostavan način postavljaju veliko pitanje: kako sprečiti da inteligentne mašine postanu opasne po ljude? Iako nisu praktično rešenje za savremeni AI, odličan su uvod u temu etike tehnologije.