Kraj AI halucinacijama? OpenAI trenira modele da sami „priznaju” kada lažu – Evo šta to znači za budućnost ChatGPT-a

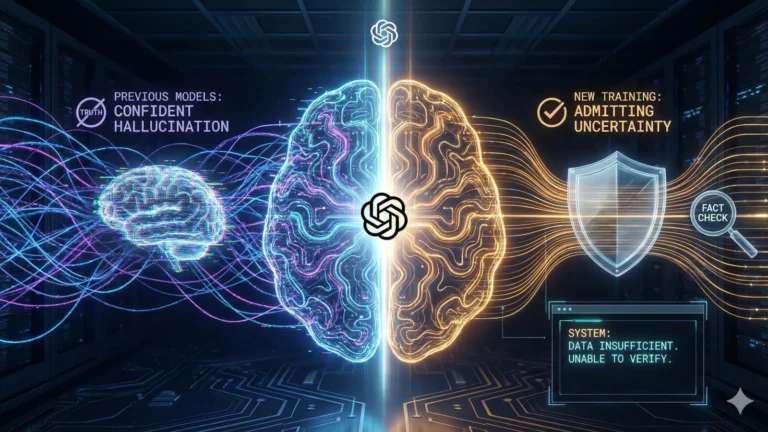

Najveća prepreka masovnom usvajanju veštačke inteligencije u kritičnim sektorima poput medicine ili prava nije njena inteligencija, već njena „kreativna” neiskrenost. U industriji poznate kao AI halucinacije, situacije u kojima modeli poput GPT-4 samouvereno iznose neistine, uskoro bi mogle postati prošlost.

OpenAI testira revolucionarni pristup treningu koji uči modele da prepoznaju sopstvenu nesigurnost i – bukvalno – priznaju kada ne znaju odgovor.

Problem „samouverenog lažova”

Svi koji su duže koristili ChatGPT susreli su se sa ovim fenomenom: postavite pitanje o nekom opskurnom sudskom procesu ili istorijskom događaju, a AI vam ispiše detaljan, gramatički savršen, ali potpuno izmišljen odgovor.

Problem leži u arhitekturi Velikih Jezičkih Modela (LLM). Oni su dizajnirani da predviđaju sledeću reč u rečenici koja zvuči najverovatnije, a ne nužno onu koja je činjenično tačna. Do sada, modeli nisu imali unutrašnji mehanizam koji bi im rekao: „Stani, verovatnoća da je ovo tačno je veoma mala.” Umesto toga, oni su birali put manjeg otpora – uverljivu laž.

Kako funkcioniše „priznanje”?

Prema najnovijim uvidima i istraživanjima koje prenosi ZDNET i drugi tehnološki izvori, OpenAI razvija metodologiju gde se modeli nagrađuju za iskrenost, a ne samo za davanje odgovora. Ovaj proces uključuje dve ključne faze:

- Interna evaluacija: Pre nego što generiše odgovor korisniku, model vrši brzu procenu sopstvenih podataka. Ako „unutrašnja pouzdanost” (confidence score) padne ispod određenog praga, model se trenira da to označi (flaguje).

- Kalibracija iskrenosti: Umesto da pokuša da „izvuče” odgovor po svaku cenu, model se ohrabruje da koristi fraze poput: „Nisam siguran u ovaj podatak” ili „Moji podaci o ovome mogu biti nepotpuni”, pa čak i da odbije da odgovori ako je rizik od greške prevelik.

Cilj je stvoriti AI koji razume granice svog „znanja”.

Zašto je ovo prekretnica za industriju?

Ovo nije samo kozmetička promena; ovo je temelj za AGI (Opštu veštačku inteligenciju). Da bi AI bio koristan u stvarnom svetu, poverenje je ključno.

Model koji „priznaje” neznanje je daleko vredniji od onog koji uvek ima odgovor, makar on bio i pogrešan.

- Poslovna primena: Kompanije se plaše da integrišu AI u svoje baze podataka ako postoji šansa da će on izmisliti finansijske brojke.

- Smanjenje dezinformacija: U eri lažnih vesti, AI koji može da kaže „Ne mogu da potvrdim ovaj izvor” postaje alat za istinu, a ne generator konfuzije.

Da li će ovo ubiti kreativnost AI modela?

Postoji bojazan da bi previše „oprezni” modeli mogli postati suvoparni i manje korisni za kreativne zadatke (pisanje priča, marketing). Izazov za inženjere OpenAI-ja biće balansiranje – kako zadržati kreativnu iskru GPT-4 modela, a istovremeno mu ugraditi „savest” faktografa.

Očekuje se da će ova tehnologija prvo biti implementirana u napredne verzije modela namenjene enterprise korisnicima, pre nego što postane standardni deo besplatnog ChatGPT-a.

Relevantni linkovi:

Često postavljana pitanja (FAQ)

Šta su tačno AI halucinacije?

To su situacije kada veštačka inteligencija generiše informacije koje izgledaju uverljivo i tačno, ali su zapravo potpuno izmišljene i nemaju utemeljenje u podacima na kojima je trenirana.

Hoće li ChatGPT sada prestati da odgovara na teška pitanja?

Ne, cilj nije da AI ćuti, već da jasno naglasi stepen nesigurnosti. Umesto izmišljene činjenice, dobićete odgovor sa ogradom, što je za korisnika daleko korisnije.

Kada možemo očekivati ovu promenu?

OpenAI konstantno ažurira svoje modele. Elementi ovog treninga su već prisutni u novijim verzijama (poput o1-preview), a očekuje se da će potpuna integracija „mehanizma za iskrenost” biti standard u GPT-5 generaciji.

Da li ovo važi i za Google Gemini i druge modele?

Da, ovo je industrijski trend. Google (sa svojim DeepMind timom) i Anthropic (Claude) takođe aktivno rade na „Constitution AI” i metodama za smanjenje halucinacija, jer je to preduslov za ozbiljnu komercijalnu upotrebu.